Differentiera eller derivera

advertisement

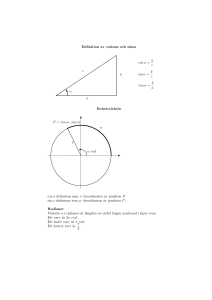

Differentiera eller derivera - det är frågan! Anders Källén September 27, 2013 1 Introduktion Differentialen av en funktion diskuteras vanligtvis bara ytligt i kurser i endimensionell analys. Motiveringen är (troligen) att skillnaden mellan differential och derivata är så liten, och eftersom differentialen “är mer komplicerad” (en funktion av två variabler) är det bättre att koncentrera sig på derivatan. Jag vill argumentera för att detta förhållningssätt är kortsiktigt och dumt. Det är sant att differentialen är umbärlig i envariabelanalys, men den är oumbärlig i flerdimensionell analys, och jag tror att rätt framställd förstår man den flerdimensionella analysen bättre om man tidigt vänjer sig vid differentialer, och tänker på dem på ett för tillämpningarna lämpligt sätt. I en-variabel analysen är skillnaden mellan differentialen och derivatan densamma som skillnaden mellan ekvationen för en linje genom origo och dess beskrivning genom dess riktningskoefficient. I två-variabel analysen är det skillnaden mellan ekvationen för ett tangentplan (genom origo) och dess beskrivning i form av riktningsvektorer, alltså planet givet på parameterform. Här ser man tydligt skillnaden mellan en- och två-variabelanalysen: i en-variabelanalysen finns bara en riktningskoefficient, men för ett plan i rummet finns många olika riktningar. Generellt sett har båda framställningarna sin plats, men det är inte självklart att parameterformen är det naturliga startskottet – eftersom det är så lite unikt. 2 Derivata contra differential Betrakta en funktion f (x) av en variabel x och rita ut dess graf y = f (x) i en omgivning av en punkt. Vi ska då titta närmare på hur funktionen ser ut i en liten omgivning av punkten, och vi gör det genom att titta på området i dess omedelbara närhet i större och större förstoring (som genom ett mikroskop). Hur det kan se ut illustreras i animationen till höger. Vi ser där på lite längre håll (lägre förstoring) ser kurvan ganska “krånglig” ut, men ju mer vi ökar förstoringen, desto mer liknar den en rät linje. Som vi snart ska se gäller detta för alla våra vanliga funktioner, och i många sammanhang är det nästan ett krav på användbarheten av en funktion att den är sådan. Vi inför därför ett speciellt namn på fenomenet att grafen till funktionen i närheten av en punkt i tilltagande förstoring mer och mer antar formen av en rät linje. Vi säger att funktionen är differentierbar i punkten. Men för att göra detta mer formellt, behöver vi vara lite mer specifika. Lägg märke till att vi i animationen inte hade lagt in något koordinatsystem, utan bara ritat kurvan. För att analysera vad vi ser matematiskt är det nämligen bekvämt att lägga sitt koordinatsystem så att punkten ligger i origo (och därmed speciellt att f (0) = 0). Eftersom vi inte gjort några direkta antaganden om funktionen än så länge borde detta inte vara en inskränkning, och vi ska se att analysen 1 kring en allmän punkt följer direkt ur detta. Den räta linjen som vi närmar oss i mikroskopet kommer då att ha formen y = kx eftersom den går genom origo. Skriv nu f (x) = k(x)x. Egentligen betyder detta bara att vi skrivit k(x) = f (x)/x. Geometriskt ser vi att den räta linje som går genom (0, 0) och (h, f (h)) har riktningskoefficient k(h). Vi kan nu matematiskt beskriva fenomenet vi ser i mikroskopet som att k(h) → k då h → 0. Funktionen g(x) = kx som ger upphov till den räta linjen kallas för differentialen av funktionen f i punkten 0. Vi ska snart ge den en speciellt beteckning. Låt oss bara först konstatera att dess riktningskoefficient k är lika med gränsvärdet y (h, f (h)) y = k(h)x y = kx f (h) , f (0) = lim h→0 h 0 x som kallas derivatan av funktionen f i punkten 0. Notera också att grafen för differentialen av f i punkten 0 är det vi kallar tangenten till grafen y = f (x) i origo. Exempel 1 För att illustrera vad vi gjort i ett enkelt exempel, betrakta funktionen sin x i en omgivning av origo. Vad vi ska göra enligt ovan är att “bryta ut” x ur denna, vilket innebär att vi skriver sin x = sin x x. x Uttrycket framför x är k(x), alltså k(x) = (sin x)/x. Vi vill se att denna är kontinuerlig i x = 0 vilket är detsamma som att visa att gränsvärdet limx→0 (sin x)/x finns. Vi vet att det är så, och att gränsvärdet är 1. Eftersom gränsvärdet finns drar vi slutsatsen att sin x är differentierbar i origo, och eftersom gränsvärdet är ett drar vi slutsatsen att derivatan i origo är 1. Anmärkning 1 Låt oss också titta närmare på “förstoringsprocessen” som beskrevs ovan. Om vi tittar på kurvan y = f (x) då −1 ≤ x ≤ 1 i lägsta förstoring, så tittar vi på kurvan y = bf (x/b), −1 ≤ x ≤ 1 när vi tittar i förstoring en faktor b. Om vi skriver h = 1/b så kan vi skriva om detta som y = f (hx) hx x och om b → ∞, alltså h → 0, så övergår denna funktion i den räta linjen y = f 0 (0)x. Anmärkning 2 För att förstå hur en funktion som inte är deriverbar någonstans kan se ut kan vi använda följande exempel från Weierstrass. Det är funktionen f (x) = ∞ X ai sin(bi x) i=1 där konstanterna a, b är sådana att ab > 1 + 3π/2. Att rita en sådan är i princip omöjligt, animationen till höger är ett försök. Men den kan ju bara göras med ändligt många termer. Vi ser hur, när vi zoomar in, svängningarna blir kraftigare, och eftersom den oändliga summan innehåller “oändligt” snabba svängningar blir det omöjligt att rita den riktiga grafen. Men att rita en tangent i en utmärkta punkten går uppenbarligen inte. (Punkten är godtyckligt vald.) 2 För att analysera vad som händer när vi zoomar in i en annan punkt (a, f (a)) på kurvan (vi antar nu inte längre att f (0) = 0) kan vi återföra det på vad vi redan gjort genom att lägga ett nytt origo i punkten (a, f (a)). Vi inför alltså nya koordinataxlar dx, dy genom dx = x − a och dy = y − f (a). Den räta linjen vi ser i mikroskopet kommer då att ha formen dy = k(a)dx (linjen kommer att bero på vilken punkt a vi väljer, så vi vill ha med det i beteckningen), alltså y − f (a) = k(a)(x − a) eller y = f (a) + k(a)(x − a). Vilken form vi nu föredrar. Att kalla koordinaterna i det nya koordinatsystemet dx och dy kommer snart att visa sig vettigt, då dessa uttryck får mer betydelse än de har just nu. Just nu är de bara koordinater. Anmärkning 3 Notera att k(a) här inte betyder samma sak som i föregående paragraf. Där var den riktningskoefficienten för en korda mellan origo och punkten (a, f (a)) på grafen, här är den riktningskoefficenten för tangenten till grafen i punkten (a, f (a)). Det vi tidigare kallade k(h) kommer nu att betecknas k(a, h). Lite förvirrande beteckningar, men alternativet är inte bättre. Förändringen i f när vi gör en ändring i h kan vi nu skriva ∆f (a)[h] = f (a + h) − f (a). Det är en lite komplicerad beteckning, men vi behöver argumentet a för att tala om att det är i punkten a vi beräknar differentialen, och vi behöver argumentet h för att tala om att det är en funktion av h1 . Komplikationen med två variabler är en övergående huvudvärk – så ha lite tålamod. Liksom vi gjorde ovan skriver vi nu ∆f (a)[h] = k(a, h)h. Vi säger nu att f är differentierbar i punkten a om riktningskoefficienten k(a, h) → k(a) då h → 0. Detta kan vi också uttrycka som att funktionen k(a, h) som funktion av a (fixt a) är kontinuerlig i h = 0. Definition 1 En funktion f som är definierad i en omgivning till en punkt a sägs vara differentierbar i a om vi kan skriva f (a + h) − f (a) = k(a, h)h där funktionen h → k(a, h) (för fixt a) är kontinuerlig i h = 0. Värdet k(a, 0) betecknas f 0 (a) och kallas derivatan av f i punkten a. Funktionen df (a)[h] = f 0 (a)h (som är en funktion av h) kallas differentialen till funktionen f i punkten a. Exempel 2 Vi ska nu räkna igenom det vi gjort ovan i ett enkelt exempel, bara för att illustrera räkningarna med ett konkret fall. Tag funktionen f (x) = x2 . Om a är en godtycklig punkt har vi då att f (a + h) − f (a) = (a + h)2 − a2 = 2ah + h2 = (2a + h)h. Här är alltså k(a, h) = 2a + h kontinuerlig i h = 0 med värdet k(a, 0) = 2a. Det följer att df (a)[h] = 2ah och alltså att f 0 (a) = 2a.. Följande sats är nu en enkel observation Sats 1 Att en funktion f av en variabel är differentierbar i en punkt a är ekvivalent med att gränsvärdet f (a + h) − f (a) h→0 h f 0 (a) = lim existerar. 1 Vi kunde här ha kallat h för dx, vilket vi snart kommer att göra via en liten omväg där vi också kommer att ge dx en mening som differentialen av x. 3 Bevis. Vi behöver bara notera att k(a, h) = f (a + h) − f (a) , h så följer satsen direkt. Vi ser alltså att för funktionen f (x) = x2 har vi derivatan f 0 (a) = 2a i punkten x = a. Detta skriver vi kortare som att f 0 (x) = 2x och betyder att funktionen f 0 som är derivatan av funktionen f har värdet f 0 (x) = 2x i punkten x. Anmärkning 4 Att en funktion som är differentierbar i en punkt också är kontinuerlig där är självklart från definitionen. Varför? Vi ska nu göra en observation som överför beteckningen för en differential i en speciell form. Funktionen x har derivatan 1 överallt, vilket betyder att dx(a) är oberonde av a och om vi därför utelämnar den från beteckningen, så ser vi att dx[h] = h. Differentialen för en allmän funktion f av en variabel x i en punkt a kan därför skrivas df (a)[h] = f 0 (a)dx[h]. Om vi utelämnar h får vi den mer kompakta beteckningen df (a) = f 0 (a)dx. Liksom för derivatan skriver man gärna df (x) = f 0 (x)dx, men här gäller det att komma ihåg att df (x) är en funktion av en annan variabel, h, och beräknas genom df (x)[h] = f 0 (x)h. Det kan verka komplicerat, men är egentligen helt naturligt. Exempel 3 Hur mycket ändras f (x) = x2 om vi ökar x från 2 till 2.01? Approximativt ges detta av df (2)[0.01] = f 0 (2) · 0.01 = 0.04. På samma sätt, om vi minskar x från 2 till 1.99 så ges ändringen approximativt av df (2)[−0.01] = −0.04. I det här fallet är det naturligtvis enkelt att räkna ut den exakta förändringen – men det är för att vi valt en extremt enkel illustration. När man tänker på relationen df (x) = f 0 (x)dx, så ska man tänka på den som att en liten ändring dx av värdet x leder till ändringen df (x) i x. Strikt matematiskt är detta inte korrekt, eftersom likhet bara gäller när dx = 0, och då står där bara 0 = 0. Men det är ändå så man ska tänka, och om man behöver matematisk stringens så kan man använda sig av följande sats. Sats 2 (Medelvärdessatsen) Låt I = [a, b] vara ett slutet intervall och f en funktion som är kontinuerlig på I. Antag dessutom att den är deriverbar i det öppna intervallet ]a, b[. Då finns ett ξ ∈]a, b[ sådant att ∆f = f 0 (ξ)∆x, där ∆f = f (b) − f (a), ∆x = b − a. Som avslutning kan vi notera att inbakat i diskussionen ovan ligger att ekvationen för tangenten till grafen y = f (x) i punkten (a, f (a)) ges av ekvationen y − f (a) = f 0 (a)(x − a), en ekvation vi också skulle kunna skriva y − f (a) = df (a)[x − a] om vi vill (men det gör vi sällan, men vi ska komma ihåg skrivsättet när vi börjar arbeta med funktioner av flera variabler). Detta är lätt att komma ihåg: dy = f 0 (a)dx och dy = y − f (a), dx = x − a. Anmärkning 5 Att hitta kontinuerliga funktioner som inte är differentierabara i en viss punkt är enkelt. Man kan utgå ifrån f (x) = |x| som inte är differentierbar i origo (kontrollera). Men finns det funktioner som är kontinuerliga men inte differentierbara någonstans? Svaret är ja, och uppenbarligen är dessa funktioner väldigt “hackiga” i alla punkter. Vi tittar inte närmare på detta här. 3 Grundläggande räkneregler Vi ska nu titta på de grundläggande räknereglerna för differentialen, och därmed motsvarande för derivator. De är alla direkta konsekvenser av motsvarande räkneregler för kontinuerliga funktioner. I bevisen handlar det helt och hållet om att “bryta ut h” och konstatera att faktorn som står framför måste vara en kontinuerlig funktion. 4 Sats 3 För differentialen har vi följande formler (i) d(f + g) = df + dg, (ii) d(f g) = f dg + gdf . Här antas funktionerna vara differentierbara i en punkt och då gäller att även summan och produkten av dem är differentierbara i den punkten och formlerna ovan gäller. Bevis. Vi lämnar (i) som övning och gör (ii). Fixera en punkt a och skriv f (a + h) − f (a) = k1 (a, h)h och g(a + h) − g(a) = k2 (a, h)h. Då har vi (f g)(a + h) − (f g)(a) = f (a + h)g(a + h) − f (a)g(a) = f (a + h)(g(a + h) − g(a)) + g(a)(f (a + h) − f (a)) = (f (a + h)k2 (a, h) + g(a)k1 (a, h))h. Men k(a, h) = f (a + h)k2 (a, h) + g(a)k1 (a, h) är enligt antagandena en kontinuerlig funktion i h = 0 med värdet f (a)g 0 (a) + g(a)f 0 (a) där. Detta betyder att produkten f g är differentierbar i a med differentialen d(f g)(a)[h] = (f (a)g 0 (a) + g(a)f 0 (a))h = f (a)dg(a)[h] + g(a)df (a)[h]. Detta är precis vad vi skulle visa. Naturligtvis följer ur detta räknereglerna (i) (f + g)0 (x) = f 0 (x) + g 0 (x), (ii) (f g)0 (x) = f (x)g 0 (x) + g(x)f 0 (x). för derivatan. (Liksom räknereglerna för differentialen följer ur dessa räkneregler för derivatan.) Exempel 4 Som illustration beräknar vi differentialen av ex sin x: d(ex sin x) = ex d sin x + sin x dex = ex cos x dx + sin x ex dx = ex (cos x + sin x)dx, vilket betyder att (ex sin x)0 = ex (cos x + sin x). Exempel 5 Sidorna på en rektangel har längderna x respektive y. Antag att dessa ändras med tiden så att x ökar med 1 mm/s och y med 2 mm/s. Hur snabbt ändrar sig rektangelns area? Det omedelbara sättet att lösa denna uppgift är att införa en tid t och notera att x = a + t, y = b + 2t. Arean är då (a + t)(b + 2t) = ab + (2a + b)t + 2t2 och hastigheten för arean blir 2a + b + 4t = 2a + b då t = 0. Samma resonemang blir naturligare om vi arbetar med differentialer. Arean är xy och vi har d(xy) = xdy + ydx. Sedan noterar vi att vi vet att dx = dt och dy = 2dt. Stoppar vi in det får vi att d(xy) = x 2dt + ydt = (2x + y)dt. Detta betyder att ändringen per tidsenhet i arean är 2x + y vid det tillfälle då sidorna är x och y. Sats 4 (Kedjeregeln) Om g är differentierbar i a och f i punkten g(a), så är differentialen i punkten a av den sammansatta funktione h(x) = f (g(x)) lika med dh(a) = f 0 (g(a))dg(a) = f 0 (g(a))g 0 (a)dx. Frågan är om denna sats behöver ett bevis. Den första likheten i satsen säger nämligen att dh = f 0 (g)dg och innebär precis att df (g) = f 0 (g)dg, vilket är vad differentialen av f är. Sedan fortsätter vi bara att skriva ut vad differentialen av g är. Det som är oklart är om vi har bevisat att den sammansatta funktionen verkligen är differentierbar. Så därför gör vi ett formellt bevis. 5 Bevis. Tag k1 , k2 som i föregående sats. Då gäller at f (g(a + h)) − f (g(a)) = f (g(a) + k2 (a, h)h) − f (g(a)) = k1 (g(a), k2 (a, h)h)k2 (a, h)h. (Det tar en stund att identifiera vad här står!) Men k(a, h) = k1 (g(a), k2 (a, h)h)k2 (a, h) är enligt antagandena en kontinuerlig funktion i h = 0 med värdet k1 (g(a), 0)k2 (a, 0) = f 0 (g(a))g 0 (a)där. Det visar att den sammansatta funktionen är differentierbar, samt anger funktionens derivata/differential. Exempel 6 När vi använder kedjeregeln för att beräkna differentialen av en sammansatt funktion är det bra att inte fixera sig på vad som är en funktion och vad som är en variabel. Betrakta följande räkning, där vi infört variabeln y = x2 i några mellanled: d(cos x2 ) = d cos y = − sin y dy = − sin x2 d(x2 ) = − sin x2 2xdx = −2x sin x dx. Räkningen illustrerar att när vi använder kedjeregeln så ser vi funktioner som variabler och jobbar rekursivt. Exempel 7 Betrakta funktionen f (x, y) = (x2 + 3y 2 )e−(x Följande räkning möter inget hinder: df (x, y) = d(x2 +3y 2 ))e−(x 2 +y 2 ) +(x2 +3y 2 )d(e−(x 2 +y 2 ) 2 +y 2 ) som är en funktion av två variabler. ) = (2xdx+6ydy−(x2 +3y 2 )(2xdx+2ydy)e−(x 2 +y 2 ) , vilket vi kan sammanfatta som 2 df (x, y) = 2x(1 − (x2 + 3y 2 ))e−(x +y 2 ) dx + 2y(3 − (x2 + 3y 2 ))e−(x 2 +y 2 ) dy. Frågan är vad detta betyder. Vad det borde betyda är att om vi gör en liten ändring dx i x och en liten ändring dy i y, så får vi ändringen df i f . Vilket är precis vad det betyder. Teorin för detta skjuter vi på, men själva räknandet finns det inget hinder för. Har vi en funktion i x och y och räknar ut dess differential får vi ett uttryck i dx och dy. Så vi kan utan vidare beräkna differentialen av funktioner av flera variabler, och tillåta oss denna tolkning av resultatet. Sats 5 Om f, g är funktioner som är differentierbara i punkten a och g(a) 6= 0, så gäller att gdf − f dg f . d( ) = g g2 Speciellt gäller att d(1/g) = −dg/g 2 . Bevis. Det räcker med att visa den andra formeln (varför?). Med k2 som ovan har vi då 1 1 g(a) − g(a + h) −k2 (a, h) − = = h, g(a + h) g(a) g(a + h)g(a) g(a + h)g(a) där koefficienten framför h är en kontinuerlig funktion av h vars värde för h = 0 är −g 0 (a)/g(a)2 . 6 En formel till behöver vi. Med hjälp av den kan vi derivera inversen till en deriverbar funktion. Hur man gör detta är egentligen självklart om man bara ritar upp vad saker betyder. Betrakta figuren till höger. Den blå kurvan är grafen för funktionen f , alltså kurvan y = f (x). Den röda kurvan är grafen för inversen, y = f −1 (x), vilken vi som bekant får genom att spegla den blå kurvan i linjen y = x. Den blå heldragna räta linjen är tangenten till y = f (x) i punkten (a, b), där b = f (a), och den röda tangenten till inversen i punkten (b, a). Den är naturligtvis erhållen ur den blå genom en spegling i linjen y = x. De sträckade linjerna är linjer med samma riktning som de heldragna, men som går genom origo. Det betyder att de blå streckade linjen är grafen till differentialen för f i a, alltså y = f 0 (a)x, medan den streckade linjen är grafen för differentialen för den inversa funktionen: y = (f −1 )0 (b)x. Men denna är erhållen ur den blå genom spegling i linjen y = x. Om vi tar linjen y = kx och speglar i linjen y = x, får vi linjen x = ky, alltså y = x/k. Vi har därför följande sats. y 2 1 −1 0 0 1 2 x −1 Sats 6 Om f är differentierbar i en punkt a och har en invers f −1 definierad i en omgivning av b = f (a), så gäller att även inversen är differentierbar och att df −1 (b) = dx . f 0 (a) Denna sats har sin motsvarighet i högre dimensioner, men måste då formuleras lite annorlunda. Viktigare är att det geometriska bevis vi gett ovan (som också visar att inversen är differentierbar) inte går att generalisera. Vi ger därför ett kort bevis som inte är geometriskt också. Bevis. Vi har en funktion f som är differentierbar i punkten a som har en invers g = f −1 i en omgivning av punkten b = f (a). Det betyder att f (g(x)) = x nära x = b och g(f (x)) = x nära x = a. Vi har då att f (g(b + h)) − f (g(b)) = h, vilket vi kan skriva (eftersom f är differentierbar) k(g(b), g(b + h) − g(b))(g(b + h) − g(b)) = h. Men g(b) = a och vi får g(b + h) − g(b) = h k(a, g(b + h) − g(b)) där vi har att nämnaren är kontinuerlig nära h = 0 med värdet k(a, g(b + 0) − g(b)) = k(a, 0) = f 0 (a) där. Alltså är g differentierbar i b (man kan notera hur denna slutsats beror av att vi från början vet att g är en kontinuerlig funktion) med derivatan 1/f 0 (a). 4 4.1 Användning av differentialen Analys av funktioner Att df (a) = f 0 (a)dx betyder att när vi gör en väldigt liten ändring dx i ett x-värde nära en punkt a, så ändrar sig f i storleksordningen f 0 (a)dx. Om vi ökar x, alltså tar dx > 0, betyder det att f ökar om f 0 (a) > 0 och minskar om f 0 (a) < 0. Det följer att funktionen måste vara växande där derivatan är positiv och avtagande där den är negativ. Ur detta kan vi dra följande slutsats. Sats 7 Om f har en lokal extrempunkt i en punkt a och är definierad i en omgivning av denna, så gäller att antingen är f inte differentierbar i den punkten, eller så är df (a) = 0. 7 De punkter a för vilka det gäller att df (a) = 0 kallas stationära punkter till f . Det är därför bland dessa vi kan hitta alla lokala extrempunkter i vilka funktionen är differentierbar. Villkoret är uppenbarligen ekvivalent med att f 0 (a) = 0, vilket ger en ekvation att lösa. Om man tycker beviset är något “luddigt” kan man modifiera det genom att använda medelvärdessatsen som nämndes ovan. Hur kan vi illustrera genom att visa följande viktiga sats. Sats 8 Om f är differentierbar i ett intervall I och df (x) = 0 för alla x ∈ I så gäller att f är konstant i intervallet. Bevis. Tag två punkter x1 < x2 i intervallet. Då gäller att f (x2 ) − f (x1 ) = f 0 (ξ)(x2 − x1 ), x1 < ξ < x2 enligt medelvärdessatsen. Eftersom vi antog att f 0 (ξ) = 0 följer att f (x2 ) = f (x1 ). Då detta är sant för alla val av punkter i intervallet måste de alla anta ett gemensamt värde. (Notera att det är viktigt att I är ett intervall!) Samma resonemang leder till att om f 00 (a) > 0 och a är en stationär punkt, så gäller att f 0 (x) < 0 då x < a (och nära a) och f 0 (x) > 0 då x > a (och nära a), dvs om vi börjar strax till vänster om a så avtar funktionen tills den vänder i just a för att därefter växa. Det betyder att vi har ett lokalt minimum i punkten a. På samma sätt ser vi att om f 00 (a) < 0 och a är en stationär punkt, så gäller att a är ett lokalt maximum. Om emellertid f 00 (a) = 0 så måste man studera om derivatan växlar tecken eller inte, och hur, i a på annat sätt. 4.2 Primitiva funktioner och differentialens invarians Ett viktigt problem inom analysen är att till en given kontinuerlig funktion f (x) hitta en differentierbar funktion F (x) sådan att dF (x) = f (x)dx. Att så alltid går är det kanske viktigaste resultatet inom analysen, men det behöver inte gå i den meningen att vi kan skriva ner ett uttryck för F (x) i de elementära funktionerna även om f (x) är ett uttryck i elementära funktioner. När man letar sådana uttryck så finns det diverse trick man kan använda. I princip innebär de alla att man går baklänges i räknereglerna för differentialen. Nedan kommer några illustrationer som enbart utnyttjar kedjeregeln. Metoden brukar kallas variabelbyte i integraler, men vi avhåller oss från att här diskutera vad som menas med integral (det kommer senare). Exempel 8 Vi vill hitta en primitiv funktion till f (x) = 1/(x2 + 2x + 26). Då kan vi räkna så här: 1 dy dx 1 dx 1 1 x+1 dx = = = = d arctan y = d arctan( ). 2 2 x2 + 2x + 26 (x + 1)2 + 25 25 ( x+1 5 y + 1 5 5 5 5 ) +1 och då noterat att dy = dx/5. Slutsatsen är att funktionen I denna räkning har vi låtit y = x+1 5 ) är en primitiv funktion till f . F (x) = 15 arctan( x+1 5 Exempel 9 Vi vill hitta en primitiv funktion till f (x) = sin2 x cos x. Då kan vi räkna såhär sin2 x cos x dx = sin2 x d(sin x) = y 2 dy = 1 1 d(y 3 ) = d(sin3 x). 3 3 Här har vi istället låtit y = sin x och då noterat att dy = cos x dx. Slutsatsen är att funktionen F (x) = sin3 x/3 är en primitiv funktion till f . Notera att man kontrollerar svaret genom att läsa från höger till vänster och se att differentieringarna stämmer. 8 4.3 Analysens huvudsats och insättningsformeln Analysens huvudsats illustrerar det ovanstående ganska bra. Antag att vi kan beräkna arean under en kurva (med tecken) över ett godtyckligt intervall. Mer precist, antag att det finns en väldefinierad area att beräkna. I integrationskalkylen visar man att om funktionen när kontinuerlig finns en sådan – det är t.o.m. så att diskussionen som leder fram till det definierar vad som menas med att en funktion är Riemannintegrerbar, och sedan visar man att en kontinuerlig funktion är Riemannintegrerbar. Antag att vi vet detta. Låt nu f vara en kontinuerlig funktion på ett intervall I = [a, b]. Definiera funktionen S därigenom att S(x) är arean över intervallet [a, x]. Analysens huvudsats säger då att S(x) är differentierbar och att dS(x) = f (x)dx. Beviset är som följer. Håll x fixt. Rent geometriskt gäller att S(x + h) − S(x) = H(x, h)h där vänsterledet är arean under grafen till f över intervallet [x, x + h] Här gäller att h 6= 0 är ett litet tal. I högerledet har vi tagit en rektangel med basen h, alltså längden av intervallet, och höjden H(x, h) så avpassad att det blir precis samma area som i vänsterledet. Denna beror naturligtvis både på x och hur brett intervall vi har. Men det är geometriskt självklart att då h → 0 så gäller att H(x, h) → f (x) (när h < 0 är intervallet egentligen [x + h, x]). Det betyder att vi kan definiera H(x, h) så att den blir en kontinuerlig funktion i en omgivning av h = 0, vilket visar att S är differentierbar i x. Tycker man inte att kontinuiteten är geometriskt självklar, så får man använda integralkalkylens huvudsats – men det är bara meningsfullt om man bevisar den ordentligt. Vad gäller insättningsformeln kan man nu resonera lite olika, beroende av vad man vill uppnå. Ett resonemang är följande. Om F är en primitiv funktion till f över intervallet [a, b] så gäller att F (b) − F (a) = n n n X X X (F (xi ) − F (xi−1 )) ≈ dF (xi )[xi − xi−1 ] = f (xi )(xi − xi−1 ) i=1 i=1 i=1 där högerledet antingen är en Riemannsumma för en integral eller en approximation av arean under grafen för f över intervallet [a, b]. 5 Differentialen av funktioner av två variabler Funktioner f av två variabler är definierade i ett område D i xy-planet och åskådliggörs grafiskt i form av sin graf, vilket är ytan som ges av ekvationen z = f (x, y) när (x, y) ∈ D. Om vi tar en punkt p på den ytan och zoomar in som vi gjorde tidigare, så kommer ofta ytan att mer och mer anta formen av ett plan. När så sker säger vi att funktionen är differentierbar i p och planet ifråga kallas tangentplanet till ytan i den punkten. För att beskriva planet kan vi som vi gjorde i den en-dimensionella analysen ovan införa ett koordinatsystem centrerat kring p: dx = x − p1 , dy = y − p2 , dz = z − f (p). Då får tangentplanet en ekvation på formen dz = adx + bdy. Funktionen i högerledet kallas differentialen av f i p och vi betecknar den funktionen (i analogi hur vi gjorde tidigare) df (p). Den är nu en funktion av dx och dy. Liksom för envariabelfallet inför vi nu beteckningen ∆f (p)[h, k] = f (p1 + h, p2 + k) − f (p1 , p2 ) 9 för förändringen i f när vi ändrar p1 till p1 + h och p2 till p2 + k. Om vi då kan skriva ∆f (p)[h, k] = k1 (p, h, k)h + k2 (p, h, k)k för några funktioner ki (p, h, k), i = 1, 2 som är kontinuerliga i (h, k) = (0, 0) säger vi att f är differentierbar i punkten p. Problemet är att om vi fortsätter med detta kommer vi snart att drunkna i beteckningar och vårt mål är att visa att flervariabelanalysen egentligen inte är svårare än envariabelanalysen. Så därför måste vi välja våra beteckningar med omdöme, och ta ett kortsiktigt investeringspris för en stor framtida vinst – som till dels kommer ganska snabbt. Vi kallar koordinaterna i kartan inte för x, y utan för x1 , x2 och skriver kort x = (x1 , x2 ). På samma sätt ersätter vi (h, k) med (h1 , h2 ) som analogt skrivs h. Vidare inför vi radvektorn k(p, h) som kort beteckning för det som ovan skrevs (k1 (p, h, k), k2 (p, h, k)). Vi upprepar nu våra definitioner i dessa beteckningar: ∆f (p)[h] = f (p + h) − f (p) och ∆f (p)[h] = k(p, h)h. I det allra sista uttrycket har vihär en matrismultiplikation mellan en radvektor k(p, h) = (k1 (p, h), k2 (p, h)) h1 och en kolonnvektor h = . Vi har alltså samma form som i envariabelanalysen, men måste komma h2 ihåg vad saker står för. Definitionen ovan innebär nu att f är differentierbar i punkten p om k(p, h) är kontinuerlig som funktion av h i h = 0. Dess värde i origo, som alltså är en radvektor, betecknar vi med f 0 (p). Differentialen df (p) definieras nu som df (p)[h] = f 0 (p)h. Men här gäller att dxi [h] = hi , så vi kan skriva detta som df (p)[h] = f 0 (p)dx[h] = f10 (p)dx1 [h] + f20 (p)dx2 [h], eller, om vi utelämnar h, df (p) = f 0 (p)dx = f10 (p)dx1 + f20 (p)dx2 . Notera att har här vi infört ytterligare en beteckning. Vad vi har gjort är att vi skrivit f 0 (p) = (f10 (p), f20 (p)). Komponenterna här betecknas på diverse olika sätt: för den i:te komponenten gäller att ∂f f (p) fi0 (p) = ∂i f (p) = ∂xi kallas den partiella derivatan av f m.a.p. xi (den i:te variabeln). Vi kan nu bara kort konstatera att räknereglerna som vi diskuterade för differentialen av en envariabelfunktion utom den som handlar om inversen till en funktion gäller precis som innan, och bevisen är desamma. Enda skillnaden är att tal har blivit matriser och multiplikation har blivit matrismultiplikation. Så vi behöver inte orda mer om detta. (Fundera gärna ut varför vi gjorde undantag för satsen om den inversa funktionen.) Exempel 10 Vi har sett att för funktionen f (x, y) = (x2 + 3y 2 )e−(x df (x, y) = 2x(1 − (x2 + 3y 2 ))e−(x 2 +y 2 ) 2 +y 2 ) gäller att dess differential är dx + 2y(3 − (x2 + 3y 2 ))e−(x 2 +y 2 ) dy. Det betyder att de partiella derivatorna m.a.p. x och y ges av ∂1 f (x, y) = 2x(1 − (x2 + 3y 2 ))e−(x 2 +y 2 ) respektive ∂2 f (x, y) = 2y(3 − (x2 + 3y 2 ))e−(x En illustration av vad detta handlar om är feluppskattningar: 10 2 +y 2 ) . Exempel 11 Om vi beräknar talet eπ genom att använda närmevärdena e = 2.718 och π = 3.142 så får vi att eπ ≈ 23.142580. Frågan är hur många av dessa decimaler som är korrekta om vi vet att felet i e är mindre än 0.0003 och felet i π är mindre än 0.00041. Nedanstående räkning ger inte ett 100% säkert exakt svar, men en god uppfattning av det. Inför funktionen f (x, y) = xy = ey ln x . Då gäller att df (x, y) = yxy−1 dx + xy ln x dy ⇒ df (2.718, 3.142) = 26.752755 dx + 23.140181 dy. Om vi här sätter in dx = 0.0003 och dy = 0.00041 så ser vi att df (2.718, 3.142) = 0.0175, så felet kan vara så stort som ungefär 0.02. Vi sammanfatter det som eπ = 23.14 ± 0.02. Det korrekta värdet på eπ med fyra decimaler är 23.1407. Vi ser att feluppskattningen är lite pessimistisk, vilket i sin tur beror på att felet i närmevärdena för e och π bär åt olika håll: för e är det en underskattning, för π är det en överskattning. En av konsekvenserna av diskussionen ovan är att tangentplanet till ytan z = f (x, y) i punkten p = (x0 , y0 ) ges av ekvationen z − f (p) = df (p)[(x − x0 , y − y0 )], vilket många vill skriva z = f (x0 , y0 ) + ∂1 f (x0 , y0 )(x − x0 ) + ∂2 f (x0 , y0 )(y − y0 ). Detta är inte en formel att lära sig. Istället räknar med differentialer och tolkar dem rätt: Exempel 12 Vi ska bestämma en ekvation för tangentplanet till ytan z = p = (2, 1). Vi börjar med att differentiera: p 9 − (x2 + y 2 ) i punkten d(9 − (x2 + y 2 )) −xdx − ydy dz = p =p . 2 2 2 9 − (x + y ) 9 − (x2 + y 2 ) I punkten (2, 1) får vi −2dx − dy 1 dz = p = −dx − dy. 2 2 2 9 − (2 + 1 ) För att få tangentplanet ersätter vi dx med x − 2, dy med y − 1 och dz med z − 2, vilket ger 1 z − 2 = −(x − 2) − (y − 1) 2 6 ⇔ 2x + y + 2z − 9 = 0. Den geometriska förståelsen av differentialen Vi har sett att differentialen är den funktion som definierar tangentplanet till en funktion i en punkt, efter att planet flyttats så att punkten blir origo. Innebörden av df (p)[v], där v är en vektor v = (x, y) är då att den mäter höjdskillnaden mellan origo och punkten (x, y) på planet. Om vi kräver att v är en enhetsvektor så betyder det precis att df (p)[v] blir riktningskoefficienten för planet i riktningen av v. Vi kallar detta uttryck för riktningsderivatan av f i riktningen v, och den skrivs ofta fv0 (p). Notera att detta kräver att |v| = 1. 2 2 Exempel 13 Vi ska beräkna riktningsderivatan i riktningen (−1, 1) av funktionen f (x, √ y) = ex +y i punkten (0, 1). För det beräknar vi först en riktningsvektor av längden 1: e = (−1, 1)/ 2 och sedan differentialen av funktionen: df (x, y) = 2ex 2 +y 2 (xdx + ydy) 11 ⇒ df (0, 1) = 2edy. Riktningsderivatan får nu som √ 1 df (0, 1)[v] = 2e √ = e 2. 2 Ett alternativt sätt att beräkna en riktningsderivata är att reducera det till ett problem i en variabel. I detta fall gör man på följande sätt. Betrakta den räta linjen r(t) = (0, 1) + tv och beräkna funktionen längs den: √ 2 2 t −t g(t) = f ( √ , 1 + √ ) = e(t +( 2+t) )/2 . 2 2 Riktningsderivatan är nu derivatan av denna funktion i t = 0, vilket man lätt ser ger samma resultat som ovan. Om funktionen f har ett lokalt maximum eller minimum i en punkt p, och är differentierbar i den, så måste uppenbarligen tangentplanet till den yta som är dess graf vara parallellt med xy-planet. Det betyder att dess ekvation är på formen z = f (p) och alltså att df (p) = 0. Mer explicit, df (p)[v] = 0 för alla riktningar v, d.vs. alla riktningsderivator är noll. Punkter p sådana att df (p) = 0 kallas även här stationära punkter, men för funktioner av två variabler måste vi lösa två ekvationer för att hitta dem. Exempel 14 Vi har sett att för funktionen f (x, y) = (x2 + 3y 2 )e−(x df (x, y) = 2x(1 − (x2 + 3y 2 ))e−(x 2 +y 2 ) 2 +y 2 ) gäller att dess differential är dx + 2y(3 − (x2 + 3y 2 ))e−(x 2 +y 2 ) dy. De stationära punkterna till funktionen får vi genom att sätta differentialen till noll, och eftersom exponentialfunktionen aldrig är noll betyder det att: ( x(1 − (x2 + 3y 2 )) = 0 x(1 − (x2 + 3y 2 ))dx + y(3 − (x2 + 3y 2 ))dy = 0 ⇔ . y(3 − (x2 + 3y 2 )) = 0 De stationära punkterna är de som löser detta system. Varje ekvation består av en produkt av två faktorer, vilket ger oss totalt fyra fall. Men ett är omöjligt: vi kan inte både ha att x2 + 3y 2 är 1 och 3. Vi har alltså följande fall x = 0 och y = 0 x = 0 och x2 + 3y 2 = 3 . 2 x + 3y 2 = 1 och y = 0 Totalt får vi fem stationära punkter: (0, 0), (0, ±1), (±1, 0). Vektorn f 0 (p) kallas gradienten för f i p. Den har en speciell betydelse som framgår ur ovanstående. Vi har ju att df (p)[v] = f 0 (p) · v (skalärprodukt av vektorer), och alltså att df (p)[v] = |f 0 (p)| · |v| cos θ, där θ är vinkeln mellan enhetsvektorn v och gradienten. Det betyder att df (p) blir som störst när θ = 0, dvs i den riktning som gradienten har. Detta resultat är så viktigt att vi formulera det som en sats. Sats 9 För differentialen gäller att |df (p)[v]| ≤ |f 0 (p)| · |v| med likhet precis då v har samma eller motsatt riktning som gradienten f 0 (p). Den praktiska innebörden av detta är att vill vi klättra så snabbt som möjligt upp för ett berg, så ska vi hela tiden gå i riktning av gradienten. Vill vi i stället gå ner så snabbt som möjligt ska vi följa den motsatta riktningen. Denna observation är motsvarigheten i två dimensioner till envariabelsobservationen att en funktion är växande om derivatan är positiv och avtagande om den är negativ. 12 Exempel 15 Paul klättrar i ett berg som beskrivs av funktionen f (x, y) = 5 − x2 − 2y 2 . Det betyder att på platsen (x, y) i kartan är höjden av berget givet av f (x, y). Han befinner sig nu i den punkt som på kartan anges av (− 23 , −1) och vill klättra i den riktning i vilken stigningen är maximal. Vilken riktning väljer han då? För att se det beräknar vi först differentialen: df (x, y) = −2xdx − 4ydy, vilket betyder att gradienten i punkten p = (x, y) ges av f 0 (p) = (−2x, −4y) och speciellt alltså för punkten (− 23 , −1) av vektorn f 0 (− 23 , −1) = (3, 4). Det är därför den riktning Paul ska ta ut, och den maximala stigningen ges av p 3 |f 0 (− , −1) = 32 + 42 = 5. 2 En annan och mycket närbesläktad observation handlar om nivåkurvor. Om vi har en parameterframställning av en nivåkurva som r(t) = (x(t), y(t)), t ∈ [a, b], så innebär det att den är nivåkurva att f (r(t)) = C, där C är nivån, för alla t. Om vi deriverar m.a.p. t får vi ekvationen df (r(t))[r0 (t)] = 0, vilket betyder att riktningsderivatan i tangentens riktning är noll alltid. Översatt till vektorspråk betyder detta att f 0 (r(t)) · r0 (t) = 0, vilket betyder att gradienten f 0 (r(t)) alltid är vinkelrät mot nivåkurvan. Denna observation stämmer bra med den ovan att gradienten pekar ut den riktning f växer snabbast i; i riktning av tangenten till en nivåkurva växer den ju inte alls! Vi illustrerar med ett exempel. Exempel 16 Vi ska bestämma ekvationen för tangenten i punkten (1, 5) till kurvan y 2 = x2 + 4x3 . För att göra det observerar vi att kurvan kan skrivas som en nivåkurva till funktionen f (x, y) = y 2 − x2 − 4x3 , nämligen nivån noll. Vi kan därför beräkna tangenten med hjälp av diskussionen ovan. För detta beräknar vi först differentialen: df (x, y) = 2ydy − 2xdx − 12x2 dx = −2(x + 6x2 )dx − 2ydy ⇒ df (1, 5) = −14dx + 10dy. Vad diskussionen ovan säger är att vi får tangenten i punkten (1, 5) genom att sätta df lika med noll och samtidigt ersätta dx med x − 1 och dy med y − 5: −14(x − 1) + 10(y − 5) = 0 ⇔ 7x − 5y = 18. Det diskuterade illustreras i nedanstående figur. Vi har här satt ∆f = f − f (p) så att nivårkurvan som går genom p har värdet noll. Tangenten i punkten p får ekvationen df (p) = 0, fast i koordinatsystemet dx = x − p1 , dy = y − p2 (se exemplet). Normalvektorn, alltså gradienten, är vinkelrät mot tangenten. f 0 (p) p 0 ∆f = df ( p) = 0 Anmärkning 6 Av figuren ovan framgår att skillnaden mellan klassisk differentialkalkyl och en baserad på differentialer i två dimensioner mycket handlar om skillnaden mellan en tangent och dess beskrivning i form av en normalvektor. I många sammanhang är skillnaden liten, men det finns en avgörande skillnad som egentligen är det yttersta skälet till varför differentialer är mer naturliga att räkna med. I 13 en klassiskt ON-system ges gradienten av vektorn (∂1 f, ∂2 f ), men om vi vill gå över till (t.ex.) polära koordinater måste vi separat härleda det uttryck som då gäller för gradienten, som är (∂r f, r−1 ∂θ f ). När vi räknar med differentialer är räkningen densamma oberoende av koordinatsystem: för ON-systemet df = ∂1 f dx+∂2 f dy och för polära koordinater df = ∂r f dr+∂θ f dθ. Detta är betydelsen av differentialens invarians (kedjeregeln) och den blir mer betydelsefull när vi tittar närmare på just variabelbyten. 7 Optimering med bivillkor Vi har sett ovan att om vi vill optimera en differentierbar funktion, så gäller att vi ska leta bland de punkter där differentialen är noll. Vi ska nu titta på ett närbesläktat problem, där vi vill hitta det största (eller minsta) värdet av en funktion f av två variabler, samtidigt som ett villkor g(x, y) = 0 gäller. Detta villkor kallas ett bivillkor, och vi ska alltså optimera funktionen f under bivillkoret att g = 0. Låt oss först försöka förstå problemet geometriskt genom att betrakta figuren nedan, som föreställer en nivåkurveplot av en viss funktion. Det kan vara lämpligt att ha en konkret bild av vad den analys vi ska göra, så vi föreställer oss att bilden föreställer en karta över ett område med höjdkonturer. Det finns en funktion f (x, y) sådan att landskapet ges av ytan z = f (x, y) i den meningen att z är höjden över havet i den punkt som på kartan har koordinaterna (x, y). Figuren föreställer kartan och inritat i den är diverse nivårkurvor f (x, y) = c för att ge en bild av hur landskapet ser ut. Q I figuren finns också en grön kurva. Denna betecknar en löprunda i landskapet och ges av en ekvation g(x, y) = 0. Vårt mål är nu att förstå hur jobbig denna runda är att P jogga längs – mer pecist att identifiera var det är uppförsbacke och var det är nedförsbacke. För det ska vi analysera hur kurvan skär nivåkurvorna. När den skär betyder det att vi antingen springer uppåt eller nedåt (beroende på i vilken riktning vi joggar). Om vi springer moturs, så ser vi t.ex. att i punkten Q är det uppförsbacke. När är vi då i en punkt där det varken går upp eller ner, d.v.s. i lokal extrempunkt? Detta sker i en punkt som den i P där joggingbanan tangerar en nivåkurva! Studerar vi kartan kring punkten P så inser vi att i just detta fall är det frågan om ett lokalt maximum, men just nu är vi mer intresserade av den enkla observationen En lokal extrempunkt på joggingrundan äger rum där tangenten till rundan och tangenten till motsvarande nivåkurva sammanfaller. Kan vi bestämma alla punkter där så sker, så har vi vad som svarar mot de stationära punkterna för detta problem. Det handlar om att se efter när df (p) och dg(p) definierar samma tangent, och kanske inser vi att det sker omm de är proportionella, vilket vi kan analysera direkt (se vidare kommentarer längre ner). Men vi ska hitta ett annat sätt som är beräkningsmässigt enklare att använda för att avgöra när så sker. Den observation vi gör då är att villkoret df = λdg betyder att df [u] = λdg[u] för alla vektorer u. Tag ett v sådant att dg[v] 6= 0. Då ser vi att λ = df [v]/dg[v] och villkoret kan skrivas att df [u]dg[v] = df [v]dg[u] för alla u. Detta motiverar följande definition och bevisar den sats som följer. Definition 2 Vi definierar kilprodukten av två differentialer på följande sätt (df ∧ dg)(p)[u, v] = df (p)[u]dg(p)[v] − df (p)[v]dg(p)[u]. 14 Sats 10 Att df och dg definierar samma tangent i en punkt är ekvivalent med att df ∧ dg = 0. För fixt p är detta en skevsymmetrisk bilinjärform i vektorerna u, v, vilket betyder bl.a. att df ∧ dg = −(dg ∧ df ). Speciellt följer att df ∧ df = 0, vilket är en viktig observation för framtiden. Liksom att df ∧ dg[u, u] = 0. Båda dessa observationer används när man räknar med kilprodukten som exemplet nedan illustrerar. Exempel 17 Vi ska bestämma maximum av funktionen f (x, y) = xy under bivillkoret att x2 + y 2 = 2. Vi formulerar bivillkoret som g(x, y) = 0 där g(x, y) = x2 + y 2 − 2. Enligt diskussionen ovan ges de stationära punkterna av de punkter på g(x, y) = 0 där df ∧ dg = 0. Vi beräknar därför kilprodukten först: df ∧ dg = (ydx + xdy) ∧ (2xdx + 2ydy) = 2x2 dy ∧ dx + 2y 2 dx ∧ dy = 2(y 2 − x2 )dx ∧ dy. De stationära punkterna ges alltså av de två ekvationerna ( ( y 2 − x2 = 0 y = ±x ⇔ x2 + y 2 − 2 = 0 x2 = 1 ⇔ (±1, ±1). Insättning visar att av dessa fyra stationära punkter är de som ger maximum ±(1, 1) och det maximala värdet är 1. Att detta är rätt ser vi lätt genom att skriva om funktionerna i polära koordinater. Vi ska då maximera √ funktionen f (r, θ) = r2 sin θ cos θ under bivillkoret r = 2. Men detta ger oss en funktion av en variabel: h(θ) = sin 2θ, som ska maximeras då 0 ≤ θ ≤ 2π, vilket blir 1 då 2θ = π/2 + k2π, k = 0, 1. Om vi inte såg denna genväg men fick funktionerna på denna form istället hade vi fått enkla räkningar: df ∧ dg = (r sin 2θ)dr + 2r2 cos 2θ dθ) ∧ dr = 2r2 cos 2θ dθ ∧ dr = 0, √ vilket ger de stationära punkterna (eftersom bivillkoret är att r = 2) som lösningar till cos 2θ = 0 ⇔ 2θ = ±π/2 + 2πk, vilket ger de giltiga lösningarna θ = π/4 + kπ/2, k = 0, 1, 2, 3, vilka därför definierar de stationära punkterna. Allt detta har en omedelbar generalisering till situationen då vi har funktioner av fler variabler och möjligen fler bivillkor. Vi lämnar dock det till en annan gång, och en annan plats. Här ska vi koncentrera oss på funktioner av två variabler för att se på fler exempel av differentialräkning. Vi avslutar detta avsnitt med att belysa vad kilprodukten betyder mer konkret. Exempel 18 Låt e1 e2 vara en ON-bas. Då gäller att (dx ∧ dy)[e1 , e2 ] = dx[e1 ]dy[e2 ] − dx[e2 ]dy[e1 ] = 1 · 1 − 0 · 0 = 1. Om vi därför skriver u = ae1 + be2 , v = ce1 + de2 , så ser man att (dx ∧ dy)[u, v] = a(dx ∧ dy)[e1 , v] + b(dx ∧ dy)[e2 , v] = ad(dx ∧ dy)[e1 , e2 ] + bc(dx ∧ dy)[e2 , e1 ] = ad − bc. a c Detta är det A där A = , som vi vet mäter arean av det parallellogram som spånns upp av b d vektorerna u och v med tecken (arean är positiv om rotationen som överför u i riktning av v är moturs, annars negativ). 15 8 Lokala extrempunkter När man i flervariabelanalys ska undersöka om en stationär punkt är en lokal extrempunkt, och vilken typ, får man oftast använda sig av andra-derivator. Men eftersom vi har många riktningar att ta hänsyn till är situationen mer komplicerad än i en variabel. För att illustrera det, låt p vara en stationär punkt till funktionen f och betrakta funktionen φ(t) = f (p + tv). När vi varierar t beskriver t → p + tv en rät linje i kartan och funktionen φ(t) höjden längs denna väg. Från envariabelanalysen vet vi då att 1 φ(t) = φ(0) + φ0 (0)t + φ00 (θt)t2 , 2 0 ≤ θ ≤ 1. Här är φ(0) = f (p), φ0 (0) = df (p)[v] = 0, men för att beräkna φ00 (t) ska vi derivera funktionen df (p+tv)[v] m.a.p. t. Om vi skriver g(x) = df (x)[v] blir då φ00 (0) lika med differentialen dg(p)[v]. Så det går att beräkna utan vidare. Men det är bara i en riktning, men diskussionen motiverar oss att betrakta B(p)[v, w] = d(df [v])(p)[w]. Vad vi gör här är följande: tag först en vektor v och beräkna df (x)[v]. Det är en funktion av x och vi kan beräkna dess differential i en ev. annan riktning w. Slutberäkningen görs i punkten p som vi undertrycker från beteckningen för stunden. Vi illustrerar räkningarna i ett enkelt exempel, men i praktiken görs de efter ett lite annorlunda recept som vi återkommer till. Exempel 19 Vi ska räkna ut B(p)[v, w] för funktionen f (x, y) = xy. Vi har att df = ydx + xdy, så g(x, y) = df (x, y)[v] = yv1 + xv2 . Dess differential blir dg(x, y) = v1 dy + v2 dx, vilket ger att dg(x, y)[w] = v1 w2 + v2 w1 . Men detta är precis B(p)[v, w] (som alltså inte beror på punkt p den här gången). Notera att ordningen av v och w här förefaller väsentlig. Men det visar sig att så inte är fallet: Sats 11 Om funktionen x → B(x)[v, w] är kontinuerlig i punkten p, så gäller att B(p) är en symmetrisk bilinjärform, d.v.s. B(p)[v, w] = B(p)[w, v]. Vi ska tänka på B(p)[v, w] som en andraderivata där vi först deriverat i riktning v och sedan i riktning w. Satsen säger alltså att det inte spelar någon roll i vilken riktning vi deriverar först. Att detta bör spela roll för att avgöra om en stationär punkt är en lokal extrempunkt är nog intuitivt klart, men hur är mindre självklart. Ytterst beror detta på att vi har många riktningar att hålla reda på, och vi kan ha ett lokalt maximum i en riktning, men går vi i en annan är där ett lokalt minimum. För fullständighetens skulle vill vi bevisa satsen innan vi diskuterar hur vi använder det hela. Bevis. Betrakta uttrycket ∆2 f (p)[v, w] = f (p + v + w) − f (p + v) − f (p + w) + f (p) som är helt symmetriskt i de två riktningarna. Enligt förutsättningarna kan vi nu skriva Z 1 Z 1 f (p + v + w) − f (p + v) = df (p + v + tw)[w]dt, f (p + w) − f (p) = df (p + tw)[w]dt, 0 0 varför skillanden blir Z ∆2 f (p)[v, w] = 0 1 (df (p + v + tw)[w] − df (p + tw)[w])dt. Men enligt förutsättningarna är g(x) = df (x)[w] differentierbar, och vi kan därför skriva df (p + v + tw)[w] − df (p + tw)[w] = g(p + v + tw) − g(p + tw) = A(p + tw, v)[v] 16 där vi har att A(p, 0)[v] = dg(p)[v] och A(x, v) är kontinuerlig i x. Stoppar vi in detta i uttrycket ovan får vi Z 1 ∆2 f (p)[v, w] = A(p + tw, v)[v]dt. 0 Om vi nu ersätter v med hv och w med kw, så kommer g(x) att ersättas av kg(x), och detsamma gäller för A. Det betyder att Z 1 ∆2 (p)f [hv, kw] = hk A(p + tkw, hv)[v]dt. 0 där integralen i högerledet konvergerar mot Z 1 A(p, 0)[v] = d(df [w])[v]. 0 Men eftersom den ursprungliga dubbeldifferensen är symmetrisk i v, w konvergerar integralen också mot uttrycket d(df [v])[w], vilket visar att de två uttrycken måste vara lika Om vi använder linjariteten i v och w så har vi nu följande sats: Sats 12 Vi kan skriva ∂2f ∂2f 2 ∂2f 2 v + 2 v v + v = (v1 , v2 ) B(p)[v, v] = 1 2 1 ∂x2 ∂x∂y ∂y 2 2 ∂2f ∂x2 ∂2f ∂x∂y ∂2f ∂x∂y ∂2f ∂y 2 ! v1 . v2 Vi kallar matrisen i högerledet för andraderivatan av f och betecknar den f 00 (p). Bevis. Om vi skriver v = v1 e1 + v2 e2 så får vi att B(p)[v, v] = B(p)[e1 , e1 ]v12 + B(p)[e1 , e2 ]v1 v2 + B(p)[e2 , e1 ]v1 v2 + B(p)[e2 , e2 ]v22 . Men B(p) var symmetrisk, vilket betyder att B(p)[e1 , e2 ] = B(p)[e2 , e1 ]! Men här gäller att B(p)[e1 , e1 ] = ∂2f (p), ∂x2 B(p)[e1 , e2 ] = ∂2f (p), ∂x∂y B(p)[e2 , e2 ] = ∂2f (p). ∂y 2 T.ex. ser vi att för att beräkna B(p)[e1 , e1 ] ska vi först beräkna df (x)[e1 ] = ∂1 f (x). Sedan ska vi differentiera den: d(∂1 f ) = ∂1 (∂1 f )dx + ∂2 (∂1 f )dy som uträknat i e1 blir d(∂1 f )[e1 ] = ∂1 (∂1 f ) = ∂12 f . Enligt vad vi sett ovan så gäller nu att kring en punkt p kan vi skriva 1 f (p + v) = f (p) + df (p)[v] + B(p + θv)[v, v], 2 0 ≤ θ ≤ 1. Antag därför att vi befinner oss i en stationär punkt. Då gäller att df (p)[v] = 0 för alla riktningar v, och vi ser att för att det ska vara ett lokalt maximum måste f (p + v) ≤ f (p) för små v (till längden). Om vi har att B(p)[v, v] < 0 för alla riktningar v och B är en kontinuerlig funktion (av p) så följer då att om v bara är liten så måste även B(p + θv)[v, v] < 0 och alltså att f (p + v) < f (p) Vi har alltså ett lokalt maximum i den punkten. Vänder vi tecknet får vi ett lokalt minimum och i två dimensioner dyker ett ytterligare alternativ upp: olika riktningar kan ha olika tecken, vilket ger en sorts punkt som kallas sadelpunkt. Liksom i endim har man problem om någon riktning är sådan att B(p)[v, v] = 0, för då vet vi inte vilket tecken vi får av B(p + θv)[v, v]. Innan vi diskuterar vad allt detta betyder uttryckt i partiella derivator, låt oss räkna igenom ett exempel utifrån hur diskussionen varit så här långt. 17 Exempel 20 Vi har sett att för funktionen f (x, y) = (x2 + 3y 2 )e−(x df (x, y) = 2x(1 − (x2 + 3y 2 ))e−(x 2 +y 2 ) 2 +y 2 ) gäller att dess differential är dx + 2y(3 − (x2 + 3y 2 ))e−(x 2 +y 2 ) dy. och att den har följande fem stationära punkter: (0, 0), (0, ±1), (±1, 0). Vi ska nu räkna ut den symmetriska bilinjärformen B ovan i dessa punkter. För det beräknar vi först andraderivatan: ! 2 2 2 2 2e−(x +y ) (1 − 5x2 + 2x4 − 3y 2 + 6x2 y 2 ) 4e−(x +y ) (x3 y + 3xy 3 − 4xy) 00 . f (p) = 2 2 2 2 4e−(x +y ) (x3 y + 3xy 3 − 4xy) 2e−(x +y ) (3 − x2 − 15y 2 + 2x2 y 2 + 6y 2 ) Vi beräknar nu vad detta blir i de stationära punkterna. (0, 0): I origo har vi B(0, 0)[v, v] = 2(v12 + v22 ) som uppenbarligen är positiv då v 6= 0. Det följer att origo är ett lokalt minimum. (0, ±1): I dessa punkter gäller att B(0, ±1)[v, v] = −4v22 − 6v22 , som uppenbarligen är negativ då v 6= 0. Dessa punkter är därför båda lokala maxima. (±1, 0): I dessa punkter gäller att B(±1, 0)[v, v] = −4v12 + 4v22 som uppenbarligen kan anta både positiva och negativa värden. Det innbär att dessa punkter är s.k. sadelpunkter. Därmed har vi bestämt typen av alla de stationära punkterna. Hur gör vi då för att avgöra om en stationär punkt när vi optimerar under bivillkor är en extrempunkt? Svaret borde vara uppenbart från diskussionen ovan, och vi illustrerar bara med ett exempel. Exempel 21 Erik ska handla godis. Han har att välja mellan geléhallon a 10 kr/hg och laktritsblanding a 5 kr/hg. Om han köper x hg geléhallon och y hg lakrits, har han en njutningskänsla som beskrivs av funktionen f (x, y) = 10(x + y) − x2 − y 2 . Han ska spendera 25 kr. Hur ska han fördela godiset? Det gäller alltså att maximera f (x, y) under bivillkoret g(x, y) = 10x + 5y − 25 = 0. Vi börjar med att beräkna df ∧ dg = ((10 − 2x)dx + (10 − 2y)dy) ∧ (10dx + 5dy) = −10(5 − x − 2y)dx ∧ dy. Vi ska därför lösa ekvationssystemet ( x + 2y = 5 10x + 5y − 25 ( ⇔ x=1 y=3 . För att se om detta är en maximipunkt beräknar vi först −2 0 00 f (x, y) = = −2I. 0 −2 Om v nu är en tangentvektor till nivåkurvan till f i punkten (1, 3), så ska vi beräkna v t f 00 (1, 3)v. I detta fall blir detta av nödvändighet negativt: v t f 00 (1, 3)v = −2v t v = −2|v|2 , vilket betyder att punkten är ett lokalt maximum. I allmänhet är problemet lite besvärligare i det att vi behöver bestämma tangentvektorn, men för det kan vi använda att gradienten till f är en normalvektor till nivåkurvan. 18 9 Vektorvärda funktioner Vi ska avsluta detta dokument med några enkla kommentarer om vektorvärda funktioner. Eftersom vi håller oss till en och två dimensioner handlar det om de två fallen r : I → R2 och φ : D → R2 , där I ⊂ R och D ⊂ R2 . Sådana funktioner dyker upp i en rad olika samband; r beskriver ofta kurvor i planet på sin parameterform, t.ex. r(t) = (cos t, sin t), t ∈ [0, 2π] som beskriver enhetscirkeln. φ i sin tur beskriver ofta koordinatbyten, såsom φ(r, θ) = (r cos θ, r sin θ), D = [0, ∞[×[0, 2π[ som beskriver sambandet mellan Cartesiska och polära koordinater. Det finns mycket att säga om sådana funktioner, men vi ska bara kort diskutera deras differentialer. r1 (t) När vi tänker på funktionen r ska vi tänka på den som att dess värde är en kolonnvektor , där r2 (t) varje element är en vanlig funktion av en variabel. Dess differential definieras då som 0 dr1 (t) r (t) dr(t) = = 10 dt. dr2 (t) r2 (t) Vi ser alltså att dr(t) = r0 (t)dt, där r0 (t) är en 2 × 1-matris. När funktionen φ är situationen snarlik. Vi ska tänka på dess värden som kolonnvektorer det gäller φ1 (x, y) , där varje element är en reellvärd funktion av två variabler. Dess differential i punkten p blir φ2 (x, y) då dφ1 (p) ∂1 φ1 (p)dx + ∂2 φ1 (p)dy ∂1 φ1 (p) ∂2 φ1 (p) dx dφ(p) = = = . dφ2 (p) ∂1 φ2 (p)dx + ∂2 φ2 (p)dy ∂1 φ2 (p) ∂2 φ2 (p) dy Matrisen i högerledet kallar vi här φ0 (p) och om vi byter x, y mot x1 , x2 , så kan vi skriva detta mer kompakt som dφ(p) = φ0 (p)dx. Precis som tidigare, med den skillnaden att φ0 (p) är en matris, som kallas funktionalmatrisen för avbildningen. Exempel 22 Om vi sätter x = r cos θ, y = r sin θ, så gäller att dx = dr cos θ + rd cos θ = dr cos θ − r sin θdθ, varför funktionalmatrisen blir cos θ sin θ dy = dr sin θ + r cos θdθ −r sin θ . r cos θ Vi kan i detta exempel också notera följande, som är ett generellt fenomen. Beräkna kilprodukten mellan dx och dy: dx ∧ dy = (dr cos θ − r sin θdθ) ∧ (dr sin θ + r cos θdθ) = r cos2 θdr ∧ dθ − r sin2 θdθ ∧ dr = rdr ∧ dθ. Detta är precis det uttryck som dyker upp när man byter från Cartesiska till polära koordinater i en dubbelintegral. För att härleda detta måste man naturligtvis föra en diskussion om dubbelintegraler, vilket ligger utanför detta dokuments ambitioner. Men det är ett generellt faktum värt att notera. Exempel 23 Vi kan också notera hur andraderivatorna från föregående avsnitt dyker upp. Låt f vara en reellvärd funktion av två variabler. Då vet vi att df (p) = f 0 (p)dx där f 0 (p) är en radvektor. Betrakta nu denna som en kolonnvektor istället (alltså f 0 (p)t ). Vi får då en vektorvärd funktion som vi kan ta differentialen av: d(f 0t )(p). Dess funktionalmatris blir då precis matrisen f 00 (p) vi diskuterade i föregående avsnitt. 10 Avslutning Målet med detta dokument har bara varit att visa att vi kan framställa den flerdimensionella analysen helt analogt med den endimensionella på ett sätt som fokuserar helt på det konceptuella innehållet. 19 Föreståelsen blir på något sätt separerad ifrån det praktiska räknandet, som blir väldigt rutinmässigt. Målet med dokumentet har bara varit att diskutera möjliga infallsvinklar till hur man lägger upp teorin – en praktisk implementering ska naturligtvis innehålla mycket annat som ytterligare belyser teorin. Men den stora vinsten kommer i vektoranalysen! Men den diskussionen lämnar vi till en annan plats skild från denna i både rum och tid! 20