LINJÄR ALGEBRA II LEKTION 6 I 1. Inre produktrum 1 2

advertisement

LINJÄR ALGEBRA II

LEKTION 6

JOHAN ASPLUND

I

1. Inre produktrum

2. Cauchy-Schwarz olikhet

3. Ortogonala projektioner och Gram-Schmidts process

4. Uppgifter

6.1:13(a)

6.1:23(a)

6.1:29

6.2:7

6.2:23

Extrauppgift från tenta

1

3

3

4

4

4

5

5

5

6

1. I

I ett vektorrum kan man som tidigare bekant beräkna skalärprodukten av två vektorer v och w. Låt oss

betrakta situationen då v, w ∈ Rn . Då kan vi beräkna deras skalärprodukt enligt

v • w = v1 w1 + · · · + vn wn .

Med skalärprodukten kan vi på ett naturligt sätt beräkna längder, avstånd och vinklar. Längden av en vektor

v ∈ Rn kan skrivas som

√

∥v∥ = v • v ,

och avståndet mellan två vektorer v, w ∈ Rn kan beskrivas som

∥v − w∥ =

√

(v − w) • (v − w) .

Vi kan också beräkna vinklar mellan två vektorer v, w ∈ R som

v•w

cos(θ) =

.

∥v∥∥w∥

Skalärprodukten tillåter oss också att avgöra om två vektorer är vinkelräta eller ortogonala som de också

kallas. Detta beteénde går att generalisera till en operation som kallas för en inre produkt. Den ”vanliga

skalärprodukten” är vad vi kallar för den euklidiska inre produkten.

Definition 1.1 (Inre produkt). Låt V vara ett reellt vektorrum. En inre produkt på V är en avbildning

V × V −→ R

(v, w) 7→ ⟨v, w⟩ ,

där ⟨v, w⟩ har följande egenskaper

(1) ⟨v, w⟩ = ⟨w, v⟩

(2) ⟨u + v, w⟩ = ⟨u, w⟩ + ⟨v, w⟩

(3) ⟨cv, w⟩ = c ⟨v, w⟩

(4) ⟨v, v⟩ > 0 för alla 0 ̸= v ∈ V

(symmetrisk)

(additiv)

(homogen)

(positivt definit)

Om vektorrummet V är utrustat med en inre produkt så kallas V för ett inre produktrum.

1

2

JOHAN ASPLUND

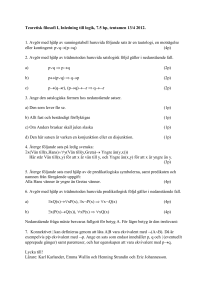

Sats 1.2. För varje matris A ∈ Rn×n , finns det en avbildning

Rn × Rn −→ R

(x, y) 7→ ⟨x, y⟩ ,

där ⟨x, y⟩ definieras som

(

⟨x, y⟩ ..= xT Ay = x1 · · ·

) A11 · · ·

.

..

xn

.

..

An1 · · ·

A1n

y1

n

∑

.

..

. =

Aij xi yj .

. .

i,j=1

Ann

yn

Anmärkning 1.3. Om A = I är identitetsmatrisen så är xT Ay = xT y den euklidiska inre produkten.

Så när är ⟨x, y⟩ som definierat i sats 1.2 faktiskt en inre produkt? Detta sker när matrisen A är symmetrisk

och positivt definit.

Definition 1.4 (Symmetrisk matris). En matris A kallas för symmetrisk om AT = A.

Den faktiska definitionen för att en matris är positivt definit är att ⟨x, x⟩ = xT Ax för alla 0 ̸= x ∈ Rn ,

men detta är inte speciellt användbart, utan vi använder följande karaktäriseringar.

Sats 1.5 (Positivt definit matris). En matris A är positivt definit om och endast om alla dess huvudminorer är

positiva. Om vi betecknar huvudminorerna med M1 , . . . , Mn så är de illustrerade för fallet n = 4 i figuren nedan.

.

M1

M2

M3

M4

1 2 3

Exempel 1.6. Om A = 4 5 6 så är huvudminorerna

7 8 9

M1 = 1

1

M2 = 4

1

M3 = 4

7

2

5

2 3

5 6 .

8 9

Det vi har kommit fram till är att en symmetrisk och positivt definit matris A ∈ Rn×n definierar en

inre produkt på Rn enligt

⟨x, y⟩ = xT Ay .

Poängen med inre produkter är att vi kan betrakta en inre produkt i till exempel Pn och beräkna längder

mellan polynom.

Exempel 1.7. I fallet då V = Rn så definieras den inre produkten som anses som standard enligt

⟨x, y⟩ =

n

∑

i=1

x i yi .

LINJÄR ALGEBRA II

LEKTION 6

3

{

}

Exempel 1.8. I fallet då V = C([a, b]) = funktioner f som är kontinuerliga på intervallet [a, b] , så definieras

den inre produkten som anses som standard enligt

⟨f, g⟩ =

∫

b

f (x)g(x) dx .

a

Exempel 1.9. I fallet då V = Rn×n så definieras den inre produkten som anses som standard enligt

⟨A, B⟩ = tr(AT B) =

n

∑

Ai Bi ,

i=1

där

A=

A1

An+1

..

.

···

···

..

.

An(n−1)+1 · · ·

An

A2n

..

,

.

B=

B1

Bn+1

..

.

···

···

..

.

Bn(n−1)+1 · · ·

An2

Bn

B2n

..

.

.

B n2

Exempel 1.10. I fallet då V = Pn så definieras den inre produkten som anses som standard enligt

⟨f, g⟩ =

n

∑

ai bi ,

i=0

där

f (x) = a0 + a1 x + . . . + an xn ,

g(x) = b0 + b1 x + . . . + bn xn .

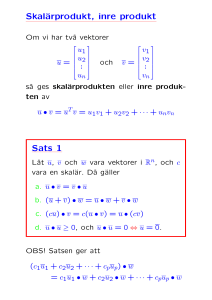

2. C-S

Sats 2.1 (Cauchy-Schwarz olikhet). I varje inre produktrum V gäller

⟨v, w⟩ ≤ ∥v∥∥w∥ .

..

√ Cauchy-Schwarz olikhet är en viktig ingrediens i beviset för följande egenskaper. Normen ∥v∥ =

⟨v, v⟩ har följande egenskaper.

Sats 2.2. I varje inre produktrum V har längd följande egenskaper

(1) ∥v∥ ≥ 0 med likhet om och endast om v = 0.

(2) ∥cv∥ = |c|∥v∥.

(3) ∥v + w∥ ≤ ∥v∥ +∥w∥.

Punkt nummer 3 i sats 2.2 kallas för triangelolikheten.

Definition 2.3. Låt v, w ∈ V vara två vektorer i ett inre produktrum. Då kallas v och w för ortogonala om och

endast om ⟨v, w⟩ = 0.

Sats 2.4 (Pythagoras sats). I varje inre produktrum gäller det att

∥v + w∥2 = ∥v∥2 +∥w∥2 ,

där v ⊥ w.

3. O G-S

Definition 3.1 (Ortonormal bas). En bas b = {b1 , b2 , . . . , bn } i ett inre produktrum V kallas för en ortonormal

bas om följande gäller.

(1) bi ⊥ bj för alla i ̸= j.

(2) ∥bi ∥ = 1 för alla i.

Anmärkning 3.2. Om en bas b endast uppfyller bi ⊥ bj för alla i ̸= j så kallas b endast för ortogonal och

inte ortonormal.

I ord beskriver man en ortonormal bas som en bas där alla vektorer är ortogonala mot varandra, och

där alla basvektorer har längd 1.

4

JOHAN ASPLUND

Sats 3.3 (Ortogonal projektion på ett delrum). Låt W ⊂ V vara ett delrum av ett inre produktrum V , och låt b

vara en ortogonal bas till W . Om v ∈ V är en godtycklig vektor så kan man beräkna den ortogonala projektionen av

v på W genom

⟨v, w1 ⟩

⟨v, wn ⟩

projW (v) =

wn .

2 w1 + · · · +

∥w1 ∥

∥wn ∥2

Anmärkning 3.4. Notera att om basen b i sats 3.3 är ortonormal så gäller det att∥wi ∥ = 1 för alla i och

därmed

projW (v) = ⟨v, w1 ⟩ w1 + · · · + ⟨v, wn ⟩ wn .

Det finns en metod som kallas för Gram-Schmidts ortonormaliseringsprocess, som används för att

konstruera en ortonormal bas, utifrån en bas (som inte behöver vara ortonormal). Den beskrivs enligt

flöjande.

Sats 3.5 (Gram-Schmidts ortonormaliseringsprocess). Låt V vara ett reellt inre produktrum, och låt u = {u1 , . . . , un }

vara en bas i V . Vi konstuerar sedan följande vektorer

u1

∥u1 ∥

u2 − ⟨u2 , v1 ⟩ v1

v2 = u2 − ⟨u2 , v1 ⟩ v1 u3 − ⟨u3 , v2 ⟩ v2 − ⟨u3 , v1 ⟩ v1

v3 = u3 − ⟨u3 , v2 ⟩ v2 − ⟨u3 , v1 ⟩ v1 ..

.

v1 =

un − ⟨un , vn−1 ⟩ vn−1 − · · · − ⟨un , v1 ⟩ v1

vn = un − ⟨un , vn−1 ⟩ vn−1 − · · · − ⟨un , v1 ⟩ v1 .

Då gäller det att {v1 , . . . , vn } är en ON-bas i V .

4. U

6.1:13(a). Låt M2 2 ha den inre produkten som definieras av

⟨U, V ⟩ = tr(U T V ) = a1 b1 + a2 b2 + a3 b3 + a4 b4 ,

där

(

U=

(

Hitta∥A∥ där A =

)

a1 a2

,

a3 a4

(

b1 b2

b3 b4

V =

)

.

)

5 3

.

2 −6

Lösning. Enligt definitionen av normen så har vi∥A∥ =

∥A∥ =

√

⟨A, A⟩ =

√

√

⟨A, A⟩. Så

52 + 32 + 22 + (−6)2 =

6.1:23(a). Låt u, v ∈ R2 , och definiera följande

⟨u, v⟩ ..= 3u1 v1 + 5u2 v2 .

Visa att ⟨·, ·⟩ definierar en inre produkt på R2 .

Lösning. Vi noterar att vi kan skriva

⟨u, v⟩ = u

(

T

)

3 0

v = uT Av .

0 5

√

74 .

LINJÄR ALGEBRA II

LEKTION 6

5

Vi vet att ett sådant uttryck definierar en inre produkt om A är symmetrisk och positivt definit. Vi ser att

AT = A, och därmed är A symmetrisk. För att avgöra om A är positivt definit så kollar vi på huvudminorerna.

M1 = |3| > 0

3 0

M2 = = 15 > 0 ,

0 5

och alltså är A positivt definit. Därför definierar ⟨u, v⟩ = uT Av en inre produkt på R2 .

6.1:29. Använd den inre produkten

⟨p, q⟩ =

∫

1

−1

p(x)q(x) dx ,

på P3 och beräkna ⟨p, q⟩ där

(a) p = 1 − x2 + 3x3 och q = 2 − x.

(b) p = x − 5x3 och q = 2 + 8x2 .

Lösning. Här kan vi använda det faktum att integreringsintervallet är symmetrisk kring origo, så att

∫1 n

∫1 n

∫1 n

−1 x dx = 0 om n är ett udda tal, och −1 x dx = 2 0 x dx om n är ett jämnt tal. Detta kommer

förenkla våra beräkningar en del.

(a) Vi får

⟨p, q⟩ =

=

∫

1

−1

∫ 1

−1

(1 − x2 + 3x3 )(2 − x) dx =

2 − 2x2 − 3x4 dx = 2

∫

1

0

∫

1

−1

⟨p, q⟩ =

1

(x − 5x )(2 + 8x ) dx =

3

−1

(

2 − 2x2 − 3x4 dx = 2 2 −

(b) På samma sätt här får vi

∫

= 2 − x − 2x2 + 7x3 − 3x4 dx

∫

2

1

−1

2 3

−

3 5

)

=

22

.

15

2x − 2x3 − 40x5 dx = 0 ,

eftersom alla termer i integranden är udda funktioner.

6.2:7. Existerar det tal k, l ∈ R så att vektorerna u = (k, 3, 2), v = (−3, 1, l) och w = (−5, 5, 1) är

parvis ortogonala med avseende på den Euklidiska inre produkten?

Lösning. Det vi vill göra är att hitta k och l så att u ⊥ v, u ⊥ w och v ⊥ w. Detta kan sammanfattas

med följande ekvationssystem

⟨u, v⟩ = 0

⇔

⟨u, w⟩ = 0

⟨v, w⟩ = 0

−3k + 3 + 2l = 0

−5k + 17 = 0

20 + l = 0

.

Ur ekvation 2 och 3 får vi l = −20 samt k = 17

5 . Vi sätter in detta i första ekvationen och inser att

ekvationen inte är uppfylld. Därför kan det inte finnas några sådana k och l.

6.2:23. Om u, v ∈ Rn och A ∈ Rn×n , bevisa att

(4.1)

(v T AT Au)2 ≤ (uT AT Au)(v T AT Av) .

Lösning. Cauchy-Schwarz olikhet säger att ⟨u, v⟩ ≤ ∥u∥∥v∥, eller ekvivalent ⟨u, v⟩2 ≤ ∥u∥2 ∥v∥2 =

⟨u, u⟩ ⟨v, v⟩. I vår uppgift så gäller det att visa att om u, v ∈ Rn och A ∈ Rn×n , så definierar ⟨u, v⟩ =

v T AT Au en inre produkt på Rn . Det är klart att AT A ∈ Rn×n , så det gäller att visa att AT A är symmetrisk

och positivt definit. Faktum är att vi inte riktigt behöver göra detta.

I kapitel 6.1 i boken visar det sig att om man kan skriva ⟨u, v⟩ = (Av)T (Au) så definierar ⟨·, ·⟩ en inre

produkt på Rn och kallas för den inre produkten som genereras av matrisen A. Eftersom (Av)T (Au) =

v T AT Au som är det vi har i uppgiften, så vet vi att ⟨·, ·⟩ är en inre produkt, och därför gäller CauchySchwarz olikhet varur olikheten (4.1) håller.

6

JOHAN ASPLUND

Extrauppgift från tenta. Låt P2 vara rummet av polynom av grad högst 2 utrustat med den inre

produkten

⟨p, q⟩ =

∫

1

p(t)q(t) dt ,

0

och låt W vara delrummet till P2 som spänns upp av p1 (t) = 1 och p2 (t) = t. Bestäm den ortogonala

projektionen av p(t) = t2 på W samt beräkna avståndet från p till W i P2 .

Lösning. För att använda sats 3.3 så måste vi först kolla om polynomen 1 och t är ortogonala. Vi beräknar

∫

⟨1, t⟩ =

1

0

[

t2

t dt =

2

]1

= 1 ̸= 0 .

0

Vi måste alltså göra om {1, t} till en ortogonal bas, och kan i samma

{ veva}göra om det till en ortonormal

bas med hjälp av Gram-Schmidt. Vi döper den nya basen till b̃ = b̃1 , b̃2 , och sätter först

b̃1 =

b1

1

= √∫

b1 = b1 .

1

∥b1 ∥

dt

0

Sedan får vi (enligt Gram-Schmidt)

b2 − projb̃1 (b2 )

.

b̃2 = b2 − projb̃1 (b2 )

Vi beräknar först ut vektorn, och normaliserar den efteråt. Så

⟨

⟩

b2 − projb̃1 (b2 ) = t − b2 , b̃1 b̃1 = t −

Längden av denna vektor är

∥t − 1∥ =

√

∫

1(

0

1

t−

2

(∫

t dt

0

√

)2

)

1

dt =

1

1

= √ .

12

2 3

Vi kan sedan beräkna projW (t2 ) som

∫

⟩√

√

projW (t ) = t , 1 1 + t , 3(2t − 1)

3(2t − 1) =

⟨

2

⟩

1

= +3·

3

⟨

1

.

2

{ √

}

b̃ = 1, 3(2t − 1) .

Alltså är en ortonormal bas

2

=t−

1

2

( )

(∫

1

2

t dt + 3

0

0

)

(2t − 1)t dt (2t − 1)

1

1

(2t − 1) = t − .

6

6

Vi har sedan att avståndet från t2 till W är avståndet från t2 till ortogonalprojektionen

1

2

d(t2 , W ) = t2 − projW (t2 ) = t

−

t

+

6

√

∫

1(

t2

=

0

E-mail address: [email protected]

1

−t+

6

√

)2

dt =

1

1

= √ .

180

6 5

2